2015夏OcuFesに参加してきました(出展コンテンツ解説編1)

OcuFesに出展した「初音ミクVRライブ shake it!」について、いろいろお話していきたいと思います。

これまで体験会で作っていたコンテンツは、基本的に音声はなし。単純なモーションが読み込まれたキャラクターモデルにHeadLookが入っていて、こっちを見てくれる…というのがメインのものです。

ですがMMD者の私としては、やはりいつかは「目の前でモデルが踊ってくれる」コンテンツをつくってみたかったし、実際に既に「目の前でモデルが踊ってくれるコンテンツ」というのは存在していました。

それらをいくつか見た結果、自分の求めているものと違う点を埋めたものが、今回出来上がったコンテンツです。

以下、既存のコンテンツを体験した上での(※あくまで自分の中だけのですので、他の人はそう感じない可能性大です)違和感。

①ダンスをしているモデルが、自分と同じ床の上に居る

いたたまれない感に苛まれる

自分の目の前に立って、モデルがダンスをしているのってこう…何か言うに言われぬ違和感があるのですね。

ダンサーの人が目の前・かつ至近距離で踊っていたらこう…演出がない限り、不思議な感じがしませんか?私はします。

というか実際やってみて違和感があった。特に、激しいダンスモーションだとなおさら。なんだろうこの人…みたいな感じになる…

本当に実際に目の前で自分を煽るように踊ってくれる、とかでない限りは、冷める…

つまり、よほどの演出がない限りは不自然。

あまり場所移動のない、腕を動かすのがメインの昔のアイドル的な振り付けなら違和感が少ないかもしれません。(そういうのも作ってみたい)

(しかし逆に、カスタムメイド3Dの歩きまわるミュージカル風ダンスにはあまり違和感をおぼえませんでした。演出として納得できる線だったのかもしれない)

②ダンスをしているモデルが、遠い

ただ、さみしい

うわーライブっぽい!!…でも、遠いな…なんかつまんないな…さみしいな…

自分だけを見てくれる方がお得感ある気がするな~

ロート製薬さんコラボのやつ、美術はすごく素晴らしかったのですけどミクさん遠いな~たまにしかこっち来ないな~さみしいな~という感がすごく強かった。複数人体験型というシステム上仕方ないことなんでしょうが。

ミクさんの投影型ライブを見に行った時も「これならうちで編集された動画見てる方がいいな~」と感じてしまった私なので(席が遠かった)…

(あと自分がoculusでの映像を見慣れているので、立体に見えるというだけでは驚きを感じなかったからかも)

このような不満点を解消するために、今回のコンテンツはこうなりました。

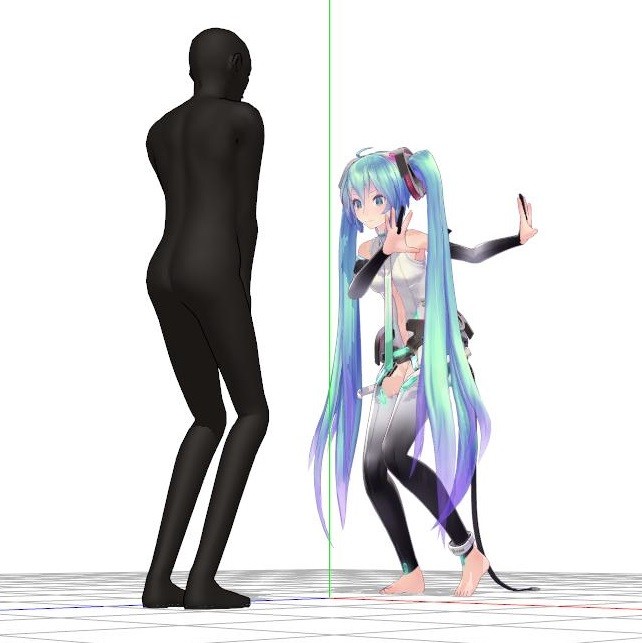

①モデルは自分よりちょっと上に立っている

Unityで位置をほんのわずか上げているだけなんですが、同じ床の上に居るよりは「舞台感」がある(ような気がする)。

②モデルがめちゃくちゃ近いところに居る

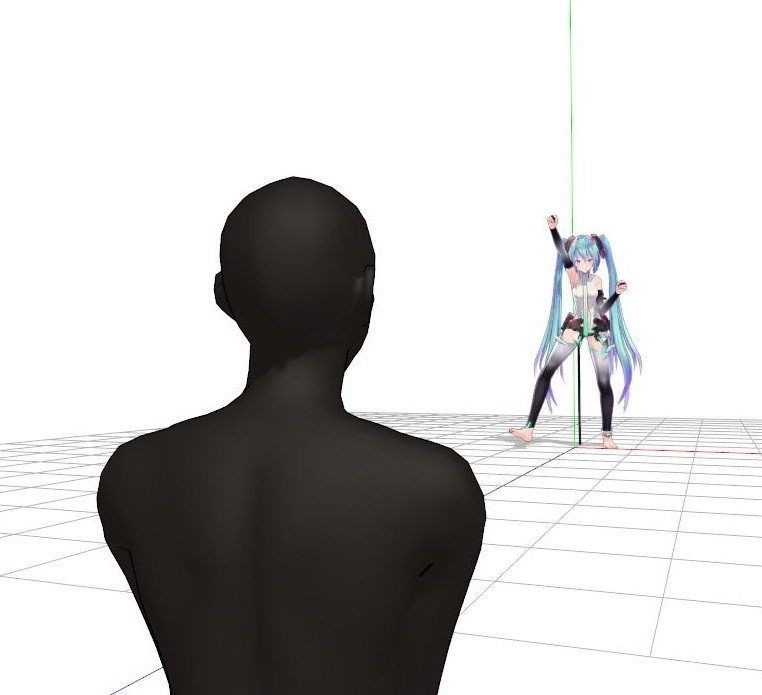

ライブで言えば、ほぼ最前列かぶりつきの位置で、自分を見下ろしてくれる(視線をくれる)。

※体験者は座って観賞、それを見下ろすような位置にモデルが立つ

モデルが本当に目の前に居るので、体験者の皆さんの多くは「近い!」と驚いてらっしゃいました。

ターンをするところなど、ミクさんのツインテに殴られそうになります。

この位置関係の欠点は、体験者が上を向きっぱなしなので、首が疲れること。

現状でのDK2の重さもあって、本当に首が疲れます(;´∀`)製品版になったらきっともっと楽になるよ!!

でも、至近距離で美しいモデルを見上げていると「はあ…ミクさん女神…」という感覚があって、個人的にはいいと思うのです。

要素として重要なのは、モデルが「自分を見てくれる」ことです。

体験会などで「キャラに出会う」体験を提供してきて、やはり「キャラが自分を見てくれる」(=認識している)という感覚は大事だと理解しています。

通常は「HeadLook」というスクリプトを用いて、Oculusの位置をカメラがトラッキングし体験者の方をモデルが向いている…ようにするのですが、今回はそれを使っていません。

とりあえず単純に、モデルにモーション入れた上でHeadLook入れても、まったく適用されなかったからw

HeadLookは今までにもモーションによっては不思議な挙動になることがあって、今回のように長くいろいろな動きのあるモーションだと、たぶんうまく反映されないのでしょう。

いろいろスクリプトをいじって直すことは出来るようなのですが、そこはそれ!プログラミングが1ミリもできない私なので「じゃあ、MMD側でモーションを調整して、モデルが下見てるみたいにすっか」…と…

モーション調整の手順としては、ごく簡単に

①両目ボーンを下にする

②頭ボーンか首ボーンを下に向かせる

③上半身2ボーンを前に曲げる

というのを愚直に手付けで行って、どうにかなりました。

うまくいくとは思わなかったのですが、体験者を座らせる=動きを制限する ことによって、体験者が立ち上がって大きく移動したりしない限りは、さほど違和感を感じないものになりました。たぶん…(;´∀`)

というわけで…HeadLookとかトラッキングとか一切関係なく…

「ただ単にモーション調整してモデルが常に体験者が座っている位置を見下ろしているように『見える』」という…

あまりにも原始的なコンテンツが爆誕したのでした…

インタラクティブ要素なくて意味あんの?という向きもあるかもしれませんが

技術的にすごいことをやろうという気はゼロどころかマイナスです(キリッ

Oculusを今までやったことない方が見て、「おお!」となってくれればそれでいい。

今後HMDが普及すればするほど、「単に眺めるだけ」のコンテンツは必要とされると思います。

いっつもゲームやってたら疲れちゃうからね。

次回は背景とか演出とかその辺のお話。

※記事画像には、Tda式ミクさん(に、わかちんさん作の「shake it!」のモーションを読み込んだもの)・ペニシスさん製作黒い人モデルを使用しています。